반응형

머신러닝의 분류도이다. 다시한번 복기해보자.

이번에는 회귀 중에서도 가장 기본인 선형 회귀(Linear Regression)에 대해 알아보자.

아래와 같이 data set(=train data)이 있다고 가정해보자. (독립변수x에 대해 종속변수y가 0~100 사이의 값을 가지면 회귀라고 부른다)

| x | y |

| 1 | 2 |

| 2 | 4 |

| 3 | 6 |

이에 따른 그래프는 다음과 같을 것이다.

여기서 H(x)는 가설을 의미하며, 위 데이터 셋으로부터 나올 수 있는 가장 이상적인 가설이다. 그러나 어떠한 연유로 H(n)과 같이 이상적이지 않은 결과 값이 나오는 가설이 만들어질수도 있다. 이때 가설과 실제값 간의 차이가 존재하는데 이를 구하는 방법을 cost function이라고 한다. 가장 기본적인 함수의 형태는 다음과 같다.

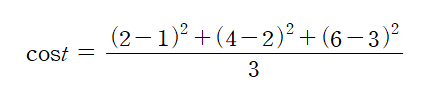

기본 형태에 의거하여 위 예시의 cost를 구하는 식은 다음과 같다.

이쯤되면 cost를 줄이는 것이 최종적인 선형 회귀의 목표라는 것을 깨달을 수 있다.

cost를 줄이기 위해 우리는 알고리즘을 사용할 수 있다. 바로 gradient descent algorithm 이다.

(이 글이 도움이 됐다면 광고 한번씩만 클릭 해주시면 감사드립니다, 더 좋은 정보글 작성하도록 노력하겠습니다 :) )

반응형

'간단 지식 > Deep Learning' 카테고리의 다른 글

| 05. 자연어 처리(NLP)에 필요한 라이브러리 및 패키지 설치 (0) | 2021.08.30 |

|---|---|

| 03. Activation - identity, softmax (0) | 2020.11.12 |

| 02. what is Deep Learning? (0) | 2020.10.23 |

| 01. what is Machine Learning? (0) | 2020.09.18 |